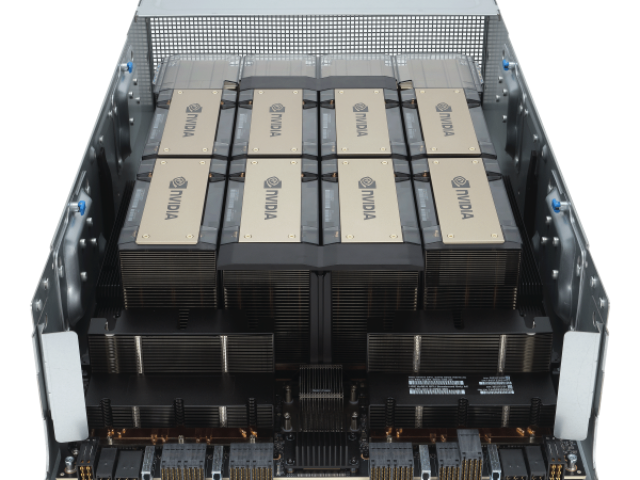

H100 GPU 还具备强大的扩展性,支持多 GPU 配置。通过 NVIDIA NVLink 技术,用户可以将多块 H100 GPU 连接在一起,形成一个强大的计算集群。NVLink 提供高带宽、低延迟的 GPU 互连,确保多 GPU 系统中的数据传输高效、稳定。这种扩展性使得 H100 GPU 可以灵活应对不同规模的计算需求,从单节点应用到大规模分布式计算环境,都能够提供出色的性能和效率。在软件支持方面,H100 GPU 配套了 NVIDIA 全的开发工具和软件生态系统。NVIDIA 提供了包括 CUDA Toolkit、cuDNN、TensorRT 等在内的多种开发工具,帮助开发者在 H100 GPU 上快速开发和优化应用。此外,H100 GPU 还支持 NVIDIA 的 NGC(NVIDIA GPU Cloud)容器平台,开发者可以通过 NGC 轻松获取优化的深度学习、机器学习和高性能计算容器,加速开发流程,提升应用性能和部署效率。H100 GPU 提供高效的计算资源利用率。xfusionH100GPU代理商

它可能每年产生$500mm++的经常性收入。ChatGPT运行在GPT-4和API上。GPT-4和API需要GPU才能运行。很多。OpenAI希望为ChatGPT及其API发布更多功能,但他们不能,因为他们无法访问足够的GPU。他们通过Microsoft/Azure购买了很多NvidiaGPU。具体来说,他们想要的GPU是NvidiaH100GPU。为了制造H100SXMGPU,Nvidia使用台积电进行制造,并使用台积电的CoWoS封装技术,并使用主要来自SK海力士的HBM3。OpenAI并不是***一家想要GPU的公司(但他们是产品市场契合度强的公司)。其他公司也希望训练大型AI模型。其中一些用例是有意义的,但有些用例更多的是驱动的,不太可能使产品与市场契合。这推高了需求。此外,一些公司担心将来无法访问GPU,因此即使他们还不需要它们,他们现在也会下订单。因此,“对供应短缺的预期会造成更多的供应短缺”正在发生。GPU需求的另一个主要贡献者来自想要创建新的LLM的公司。以下是关于想要构建新LLM的公司对GPU需求的故事:公司高管或创始人知道人工智能领域有很大的机会。也许他们是一家想要在自己的数据上训练LLM并在外部使用它或出售访问权限的企业,或者他们是一家想要构建LLM并出售访问权限的初创公司。他们知道他们需要GPU来训练大型模型。SingaporeSupermicroH100GPUH100 GPU 的增强时钟频率可达 1665 MHz。

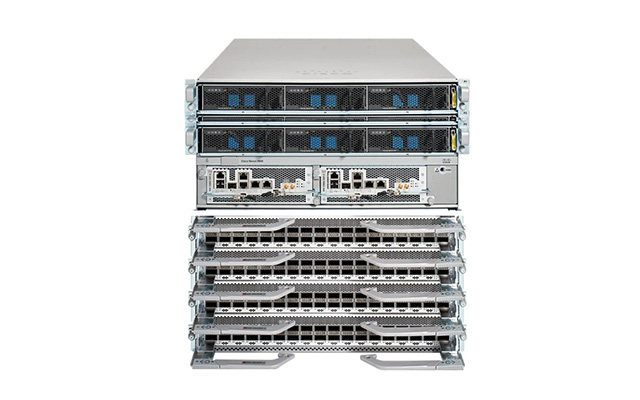

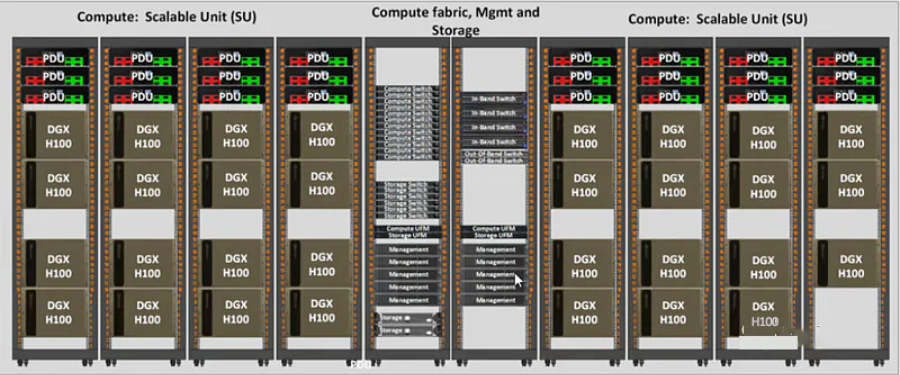

他们与来自大云(Azure,GoogleCloud,AWS)的一些人交谈,试图获得许多H100。他们发现他们无法从大云中获得大量分配,并且一些大云没有良好的网络设置。因此,他们与其他提供商(如CoreWeave,Oracle,Lambda,FluidStack)进行了交谈。如果他们想自己购买GPU并拥有它们,也许他们也会与OEM和Nvidia交谈。终,他们获得了大量的GPU。现在,他们试图获得产品市场契合度。如果不是很明显,这条途径就没有那么好了-请记住,OpenAI在更小的模型上获得了产品市场契合度,然后将它们扩大了规模。但是,现在要获得产品市场契合度,您必须比OpenAI的模型更适合用户的用例,因此首先,您将需要比OpenAI开始时更多的GPU。预计至少到100年底,H2023将短缺数百或数千次部署。到2023年底,情况将更加清晰,但就目前而言,短缺似乎也可能持续到2024年的某些时间。GPU供需之旅。大版本取得联系#作者:克莱·帕斯卡。问题和笔记可以通过电子邮件发送。新帖子:通过电子邮件接收有关新帖子的通知。帮助:看这里。自然的下一个问题-英伟达替代品呢?#自然的下一个问题是“好吧,竞争和替代方案呢?我正在探索硬件替代方案以及软件方法。提交我应该探索的东西作为此表格的替代方案。例如。

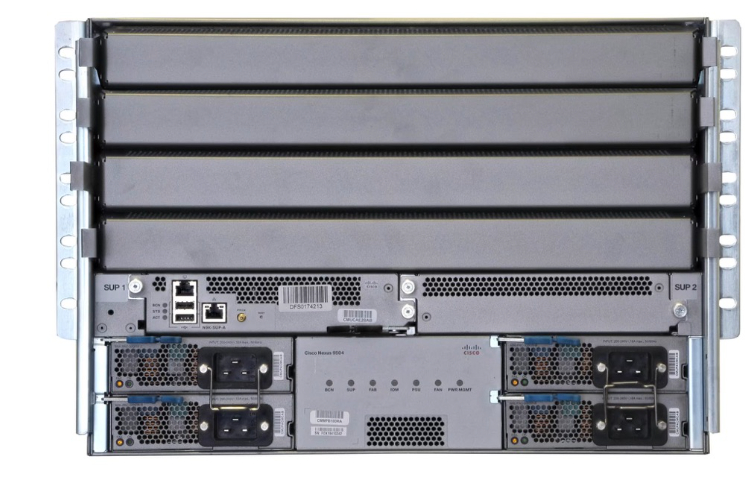

H100 GPU 还集成了多种先进的安全和管理功能。例如,它支持 NVIDIA 的 GPU Direct 技术,能够实现 GPU 之间的直接通信,减少了 CPU 参与的数据传输延迟,提升了数据传输效率。此外,H100 GPU 还支持多种虚拟化技术,如 NVIDIA vGPU,能够在虚拟化环境中提供高性能的图形和计算服务。其多样化的管理和安全功能,使得 H100 GPU 在企业级数据中心和云计算平台中具备了更高的适用性和管理便捷性。在能效方面,H100 GPU 也表现优异。其功耗设计为 400W,但在实际使用中,通过优化负载分配和动态电压频率调节(DVFS)技术,可以有效降低功耗,提高能效比。对于需要长时间运行的大规模计算任务,H100 GPU 的高能效设计不仅可以降低运营成本,还减少了对环境的影响。其先进的功耗管理技术确保了在提供高性能计算的同时,依然能够保持较低的能源消耗。H100 GPU 提供高效的技术支持。

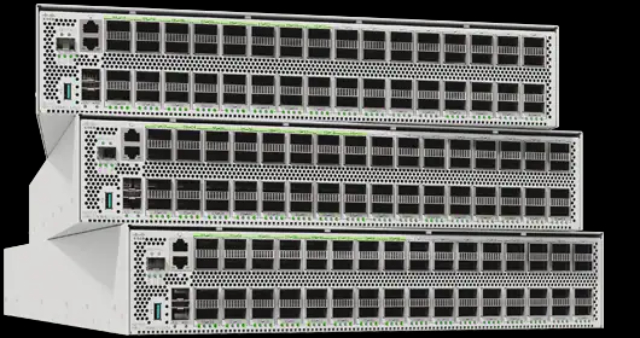

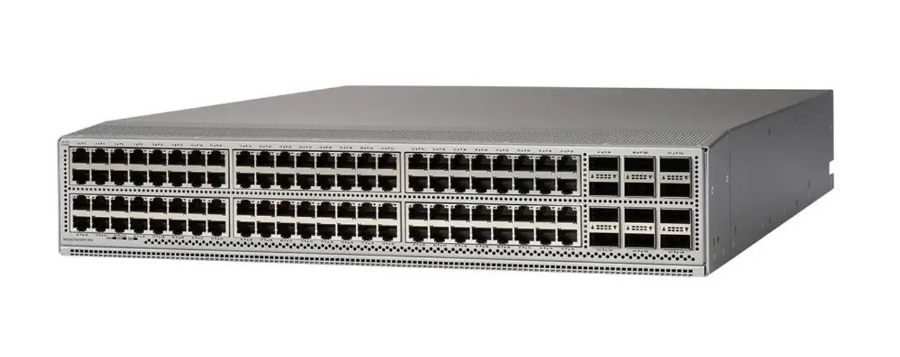

第四代NVIDIANVLink在全归约操作上提供了3倍的带宽提升,在7倍PCIeGen5带宽下,为多GPUIO提供了900GB/sec的总带宽,比上一代NVLink增加了50%的总带宽。第三代NVSwitch技术包括驻留在节点内部和外部的交换机,用于连接服务器、集群和数据中心环境中的多个GPU。节点内部的每个NVSwitch提供64个第四代NVLink链路端口,以加速多GPU连接。交换机的总吞吐率从上一代的。新的第三代NVSwitch技术也为多播和NVIDIASHARP网络内精简的集群操作提供了硬件加速。新的NVLinkSwitch系统互连技术和新的基于第三代NVSwitch技术的第二级NVLink交换机引入地址空间隔离和保护,使得多达32个节点或256个GPU可以通过NVLink以2:1的锥形胖树拓扑连接。这些相连的节点能够提供TB/sec的全连接带宽,并且能够提供难以置信的一个exaFlop(百亿亿次浮点运算)的FP8稀疏AI计算。PCIeGen5提供了128GB/sec的总带宽(各个方向上为64GB/s),而Gen4PCIe提供了64GB/sec的总带宽(各个方向上为32GB/sec)。PCIeGen5使H100可以与性能高的x86CPU和SmartNICs/DPU(数据处理单元)接口。H100 GPU 的带宽高达 1.6 TB/s。SingaporeSupermicroH100GPU

H100 GPU 促销优惠,赶快购买。xfusionH100GPU代理商

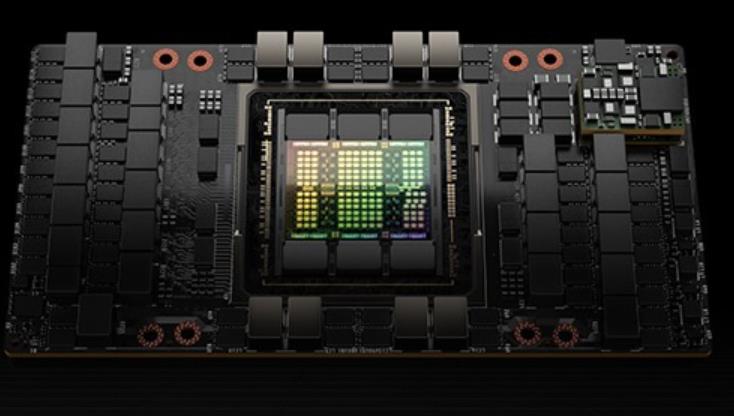

在浮点计算能力方面,H100 GPU 也表现出色。其单精度浮点计算能力(FP32)达到 19.5 TFLOPS,双精度浮点计算能力(FP64)达到 9.7 TFLOPS,适用于科学计算、工程仿真和金融建模等高精度计算需求的应用。此外,H100 GPU 还支持 Tensor Core 技术,其 Tensor Core 性能可达 312 TFLOPS,特别适合深度学习和神经网络训练等需要大量矩阵运算的任务,极大地提升了计算效率。H100 GPU 配备了 80GB 的 HBM2e 高带宽内存,带宽高达 1.6 TB/s,这使得其在处理大规模数据集时能够快速读写数据,减少数据传输的瓶颈。高带宽内存不仅提升了数据传输效率,还确保了 GPU 在处理复杂计算任务时的高效性和稳定性。对于需要处理大量数据的应用,如大数据分析和人工智能训练,H100 GPU 的大容量和高带宽内存无疑是一个巨大的优势。xfusionH100GPU代理商

文章来源地址: http://txcp.chanpin818.com/csjhsb/wljhj/deta_22735999.html

免责声明: 本页面所展现的信息及其他相关推荐信息,均来源于其对应的用户,本网对此不承担任何保证责任。如涉及作品内容、 版权和其他问题,请及时与本网联系,我们将核实后进行删除,本网站对此声明具有最终解释权。

[VIP第1年] 指数:3

[VIP第1年] 指数:3